W 2012-tym roku, dzięki Fundacji na rzecz Nauki Polskiej, miałem wielką przyjemność uczestniczyć w Spotkaniu Laureatów Nagrody Nobla w dziedzinie fizyki w Lindau. Jednym z mecenasów spotkania w Lindau był Singapur, reprezentowany przez ówczesnego prezydenta (fizyka i matematyka) Tony’ego Tana. Singapur to malutkie państwo-miasto nie posiadające własnych zasobów naturalnych. Charakteryzujące się jednak bardzo dynamiczną i nowoczesną gospodarką opartą na usługach i rozwoju zaawansowanych technologii. Kluczowym elementem polityki Singapuru jest kierowanie dużych nakładów finansowych na badania naukowe. Jako przykład osiągnięć w dziedzinie nauki, które mogą mieć praktyczne zastosowanie zaprezentowano wyniki Centrum Technologii Kwantowych na Uniwersytecie w Singapurze. Dyrektor tego instytutu, prof. Artur Ekert, przedstawił pomysł stworzenia satelitarnego systemu przesyłania informacji wykorzystującego kryptografię kwantową. Był to wtedy, z technicznego punktu widzenia, niezwykle ambitny projekt, wręcz futurystyczny. Jednak, jak zaprezentowano podczas spotkania, udało się już zbudować pierwsze prototypowe elementy takiego systemu. Projekt ten wybrano do prezentacji w Linadu nie bez przyczyny. To w realizację takich pomysłów każdy z uczestników spotkania bez wahania chciałby się włączyć. A Singapur właśnie na takich ludzi liczył by zasilili zaplecze naukowe swojej nowoczesnej gospodarki.

W 2017-tym roku, pięć lat po mojej wizycie w Lindau, marzenie o kwantowej łączności satelitarnej ziściło się. Stało się to jednak nie za sprawą Singapuru lecz Chin, które mogły pozwolić sobie na znacznie większe zaangażowanie finansowe w realizację tego celu. Sam koszt budowy, wykorzystanej do przeprowadzenia kwantowej komunikacji, satelity Micius pochłonął kwotę około 100 milionów dolarów. Satelita ten został wyposażony w specjalny transmiter umożliwiający przeprowadzenie tak zwanej Kwantowej Dystrybucji Klucza (KDK) (ang. Quantum Key Distribution (QKD)). KDK jest podstawowym narzędziem w kryptografii kwantowej, zapewniającym bezwarunkowe zabezpieczenie przekazu informacji. Odporność na ataki wynika tutaj wprost z zasad mechaniki kwantowej.

Wytłumaczę trochę dokładniej jak to działa. Mianowicie, podstawowym problemem związanym z bezpieczną wymianą informacji jest przekazanie klucza który służy do zaszyfrowania i odszyfrowania wiadomości (w ramach kryptografii symetrycznej ten sam klucz jest wykorzystywany zarówno do zaszyfrowania jak i odszyfrowania wiadomości). Idealną sytuacją jest gdy może nastąpić bezpośrednia wymiana takiego klucza. Jest to jednak bardzo niepraktyczne rozwiązanie, stosowane aczkolwiek do zabezpieczania najwrażliwszego typu informacji. Powszechnie wykorzystuje się natomiast tak zwaną kryptografię asymetryczną, opartą na kluczu publicznym oraz prywatnym. Metodę tę stosujemy (nieświadomie) każdego dnia korzystając z kart płatniczych czy też dokonując zakupów w internecie. Jednakże, dostępne w przyszłości moce obliczeniowe oraz algorytmy kwantowe bez trudu poradzą sobie z pokonaniem dzisiejszych zabezpieczeń opartych o klucz publiczny. Rodzi to uzasadnione obawy, że na przykład zaszyfrowane cenne dane będą przechowywane i rozszyfrowane w przyszłości.

Kwantowa dystrybucja klucza dostarcza metody (teoretycznie) całkowicie bezpiecznego przekazania klucza dla systemów kryptografii symetrycznej. W metodzie tej, klucz w postaci ciągu bitów, kodowany jest za pomocą stanów kwantowych. W praktyce, wykorzystywane są do tego celu pojedyncze kwanty światła, czyli fotony. Każdy bit odpowiada pewnej ustalonej superpozycji dwóch możliwych polaryzacji światła. Podstawową własnością mechaniki kwantowej jest to, że dokonanie pomiaru redukuje stan kwantowy do jednego ze stanów bazowych. W rozważanym przypadku, stany bazowe odpowiadają dwóm polaryzacjom fotonu. Każda próba przechwycenia przesyłanej w ten sposób informacji (wiążąca się z wykonaniem pomiaru na stanie kwantowym) może być więc bez trudu wykryta. Służą do tego celu odpowiednie protokoły kwantowej dystrybucji klucza. Pierwszym, wynalezionym jeszcze w 1984-tym roku protokołem tego typu jest BB84 (Bennett-Brassard 1984). Satelita Micius realizuje KDK właśnie w oparciu o protokół BB84, w konfiguracji downlink. Oznacza to, że satelita traktowana jest jako tak zwany zaufany dystrybutor klucza, umożliwiający stacjom naziemnym zaszyfrowanie i odszyfrowanie wiadomości. Pojedyncze fotony, niezbędne do realizacji KDK, przygotowywane są przez złożony układ optyczny umieszczony w satelicie. Wartym podkreślenia jest to, że sama zaszyfrowana wiadomość nie jest transmitowana przez kanał kwantowy lecz poprzez łącze radiowe. Przesyłanie informacji w postaci kwantowej jest nieefektywne i służy wyłącznie do przekazania klucza.

Szczegóły przeprowadzonych, pomiędzy majem a lipcem 2017-tego roku, udanych międzykontynentalnych kwantowych dystrybucji klucza zaprezentowano w artykule opublikowanym w styczniu bieżącego roku na łamach Physical Review Letters [arXiv:1801.04418]. W wykonanych eksperymentach, satelitę Micius orbitującą Ziemię na wysokości około 500 km wykorzystano jako zaufanego dystrybutora klucza do stacji naziemnych, zlokalizowanych w Xinglong w Chinach i w Graz w Austrii.

Zrealizowano dwa testy demonstrujące poprawną pracę systemu. Test pierwszy polegał na przesłaniu zaszyfrowanych, za pomocą szyfru z kluczem jednorazowym (ang. one-time-pad), niewielkich obrazów o rozmiarach kilku kB każdy. Z Chin do Austrii przesłano obrazek przedstawiający chińskiego filozofa Mo Di (od Niego pochodzi nazwa satelity Micius), natomiast z Austrii do Chin przesłano zdjęcie jednego z ojców mechaniki kwantowej Erwina Schrödingera. Klucz potrzebny do zaszyfrowania oraz odszyfrowania wiadomości udostępniła, poprzez kwantową dystrybucję klucza, satelita Micius. Wykorzystanie szyfru z kluczem jednorazowym, który jest najsilniejszym sposobem szyfrowania, wymaga użycia klucza o tej samej ilości bitów co wiadomość. Jest więc on z jednej strony bardzo niepraktyczny ale w zamian gwarantuje (przy poprawnym użyciu) stuprocentowe bezpieczeństwo przesyłanej informacji. Dlatego też jest on stosowany w przypadku wiadomości o najwyższej klauzuli tajności.

Przesłanie zaszyfrowanych zdjęć przebiegło w następujący sposób: Satelita Micius, za pomocą protokołu KDK, udostępnił klucz zarówno nadawcy jak i odbiorcy wiadomości. Klucz musiał mieć w tym przypadku rozmiar przesyłanej wiadomości, czyli kilka kB.

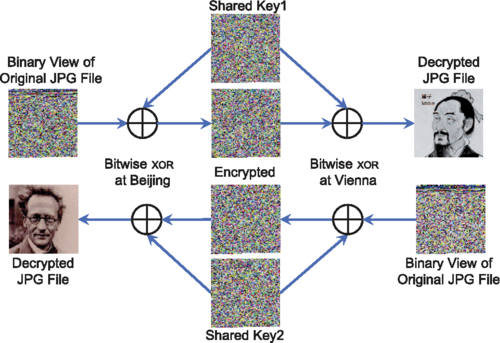

Obraz w formacie JPG zapisano w postaci mapy bitowej (matryca zer i jedynek) tworząc w ten sposób wiadomość binarną. Następnie, pomiędzy bitami wiadomości a bitami klucza, nadawca wykonał operację alternatywy rozłącznej XOR (reprezentowanej przez symbol , to dlaczego stosuję się tutaj operację XOR jest prosto wytłumaczone w niniejszym linku). W ten sposób, powstał szyfrogram który następnie został wysłany przez satelitarne łącze radiowe do odbiorcy. Otrzymany przez odbiorcę szyfrogram w postaci ciągu bitów złożono, ponownie poprzez spójnik logiczny XOR, z kluczem. W ten sposób odszyfrowana została oryginalna wiadomość.

Test drugi polegał na przeprowadzeniu telekonferencji pomiędzy Chińską Akademią Nauk a jej austriackim odpowiednikiem, podczas której przesył informacji przez klasyczne łącze radiowe zaszyfrowany został z wykorzystaniem kluczy udostępnionych przez satelitę Micius. Zastosowanie szyfru z kluczem jednorazowym do transmisji wideo nie byłoby możliwe. Dlatego też wykorzystano metodę która wymaga mniejszych rozmiarów klucza. Posłużono się mianowicie symetrycznym szyfrem blokowym Advanced Encryption Standard (AES)-182, certyfikowanym przez National Security Agency do szyfrowania ściśle tajnych informacji. Dla przykładu, w oparciu o AES, ale z kluczem o długości 256 bitów, pracuje popularny serwis Boxcryptor (wcześniej znany jako Cloudfogger). W celu zapewnienia odpowiedniego poziomu zabezpieczenia, w trakcie 75 minutowej telekonferencji, zmiana 128-bitowego klucza następowała co jedną sekundę. Szyfrowanie transmisji wymagało więc łącznie przesłania około 70 kB danych poprzez kanał kwantowy.

Dlaczego opisane powyżej wyniki są tak ważne? Przyczynę związaną z bezpieczeństwem przesyłu informacji zarysowałem już częściowo powyżej. Natomiast, wyjaśnienia wymaga kwestia wykorzystania do tego celu przestrzeni kosmicznej. Dlaczego nie przesłać fotonów przez światłowód, jak to ma miejsce w standardowych łączach internetowych? Otóż, istnieją istotne ograniczenia związane z realizacją kwantowej dystrybucji klucza przez łącza światłowodowe. W przypadku klasycznej transmisji światłowodowej, tłumienie sygnału na dużych odległościach możemy kompensować przez stosowanie odpowiednich wzmacniaczy sygnału. Mamy tu jednak do czynienia z pakietami falowymi fotonów które zachowują się w sposób klasyczny. W przypadku KDK, klucz przekazywany jest za pomocą pojedynczych fotonów, które zachowują się w sposób kwantowy. Z uwagi na obowiązujący w mechanice kwantowej tak zwany zakaz klonowania kwantowego, nie jest możliwie, w przypadku pojedynczych kwantów światła, przeprowadzenie prostego wzmocnienia sygnału. Można natomiast zastosować tak zwane kwantowe powielacze (ang. quantum repeaters), opierające swoje działanie o pamięć kwantową oraz protokół teleportacji kwantowej. Są to bardzo skomplikowane układy. Jednakże nawet ich zastosowanie pozwala obecnie na realizację KDK na odległościach maksymalnie około 300 km. Wykorzystanie przestrzeni kosmicznej staje się w tej sytuacji idealnym rozwiązaniem. Mianowicie, dla fotonów podróżujących przez atmosferę i próżnię zarówno osłabienie sygnału jak i jego dekoherencja są wielokrotnie słabsze niż w przypadku światłowodów. Kosmos jest więc obecnie nie tyle możliwością do realizacji dalekodystansowej kwantowej dystrybucji klucza ale wręcz koniecznością.

Dalszy kierunek rozwoju technologii satelitarnej KDK to utworzenie międzykontynentalnej sieci łączności kwantowej. Sieć taką przyjęło się określać mianem internetu kwantowego. Internet kwantowy, o którym napiszę kiedyś bardziej szczegółowo, będzie pozwalał na bezpieczne przesyłanie informacji na dużych odległościach na lądzie, jak i następnie w powietrzu i na wodzie. System znajdzie zastosowanie wszędzie tam gdzie potrzebny jest najwyższy poziom ochrony przekazywanej informacji. Czyli wyjściowo będą to głównie obszary takie jak: finanse, obronność, handel czy medycyna. Nie będzie również przeszkodą „przeciągnięcia” kwantowego internetu poza Ziemię. Kosmiczna próżnia jest wszak idealnym medium do przesyłania informacji kwantowej.

Wróćmy jednak na koniec na Ziemię. Posiadanie technologii satelitarnej KDK pozwoli Chinom wypracować realną przewagę na gruncie militarnym. Przykładowo, z pomocą satelitarnej KDK możliwe będzie wysyłanie rozkazów do łodzi podwodnych czy też lotniskowca/ców stacjonujących na Oceanie Spokojnym, bez obawy o przechwycenie tajnych informacji przez systemy nasłuchu innych państw i ich pomyślną kryptoanalizę. Posiadanie tej technologii, w perspektywie kliku/kilkunastu lat, może realnie ułatwić Chinom realizację swoich strategicznych celów. A chociażby z przykładu Enigmy dobrze wiemy, że od kryptografii mogą zależeć losy Świata.

© Jakub Mielczarek